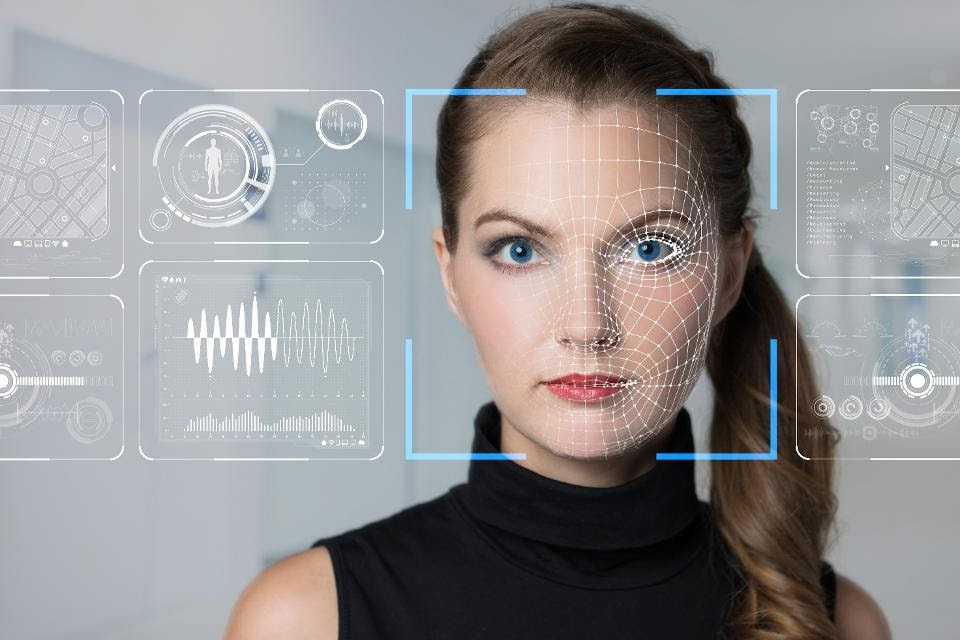

O deepfake vai fazer com que 30% das empresas deixem de acreditar na eficácia de soluções de reconhecimento facial para verificação e autenticação de identidade. O dado é do Gartner e considera que isso vai ocorrer até 2026 devido aos ataques que utilizam deepfakes geradas por Inteligência Artificial (IA) para criar falsas biometrias faciais.

A deepfake hoje é utilizada para criar vídeos falsos, seja para entreter ou para enganar pessoas. Analistas da consultoria, no entanto, dizem que estas imagens geradas artificialmente de rostos de pessoas reais podem ser utilizadas para minar a autenticação biométrica ou torná-la ineficiente, se operada sozinha. Como consequência, a confiança no reconhecimento facial como medida de autenticação cairá.

Os processos de verificação e autenticação de identidade usando biometria facial hoje dependem da detecção de ataques de apresentação (PAD) para avaliar a vivacidade do usuário. Acontece que os padrões e processos de teste atuais para definir e avaliar mecanismos PAD não cobrem ataques de injeção digital usando deepfakes geradas por IA que atualmente podem ser criadas, dizem os analistas.

Segundo pesquisa do Gartner, os ataques de apresentação são o vetor mais comum, mas os ataques de injeção aumentaram 200% em 2023. Prevenir tais ataques exigirá uma combinação de PAD, detecção de ataques de injeção (IAD) e inspeção de imagens.

A recomendação é de que os CISOs e os líderes de gestão de riscos devem escolher fornecedores que possam demonstrar suas capacidades e um plano que vai além das normas atuais, assim como comprovar que estão monitorando, classificando e quantificando esses novos tipos de ataques. Uma vez definida a estratégia e estabelecida a linha de base, os CISOs incluir sinais adicionais de reconhecimento, como a identificação de dispositivos e a análise comportamental, para aumentar a detecção de eventuais ataques e riscos aos processos de verificação de identidade.

Acima de tudo, os líderes devem tomar medidas para mitigar os riscos de ataques de deepfake selecionando tecnologias que possam provar a presença humana genuína e implementando medidas adicionais para evitar a apropriação de contas.